随着电子商务的蓬勃发展,淘宝作为国内最大的在线购物平台之一,其海量的商品数据已成为市场研究、价格监控、竞品分析乃至个人选品的重要资源。因此,淘宝商品采集软件的需求日益增长。本文旨在探讨这类软件的典型功能、开发要点及合规注意事项。

一、核心功能需求

一款实用的淘宝商品采集软件,通常需要具备以下核心功能:

- 智能数据抓取:能够根据关键词、商品链接、店铺ID或商品类别,自动化抓取商品信息。这包括但不限于商品标题、价格、销量、评价、详情页图片、规格参数、卖家信息等。

- 数据清洗与结构化:将抓取的原始HTML或JSON数据,自动清洗、去重,并整理成结构化的表格(如Excel、CSV格式),便于后续分析与使用。

- 定时与增量采集:支持设置定时任务,实现周期性数据监控。增量采集功能则能智能识别并只抓取自上次采集后发生变动的数据,提高效率。

- 反爬虫策略应对:淘宝平台具有完善的反爬虫机制。软件需要能模拟正常用户行为(如随机延迟、使用代理IP池、模拟浏览器User-Agent等),以维持采集的稳定性。

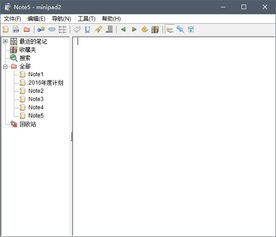

- 用户友好的界面:提供简洁直观的图形用户界面(GUI),方便用户设置采集任务、查看进度、管理已采集的数据。

- 数据导出与API接口:支持多种格式的数据导出,并为高级用户或企业应用提供API接口,便于将采集的数据集成到自有系统中。

二、技术开发要点

开发此类软件,技术选型和架构设计至关重要。

- 技术栈选择:

- 后端/核心抓取:Python是首选语言,因其拥有强大的爬虫生态库,如Scrapy、Selenium、Playwright、Requests等,能高效处理网页解析和反爬策略。

- 前端界面:对于桌面应用,可使用PyQt、Tkinter、Electron等框架;对于Web应用,则可采用Vue.js、React等。

- 数据存储:初期可使用SQLite、MySQL,大规模数据可考虑MongoDB或直接导出为文件。

- 关键实现环节:

- 请求模拟:熟练分析淘宝页面的网络请求(XHR),尽可能通过调用其内部API接口直接获取结构化数据,这比解析整个HTML页面更高效、稳定。

- 登录与验证:如需采集需要登录才能查看的数据(如店铺后台数据),需妥善处理登录态(Cookie/Session)的管理和验证码识别问题。

- 并发控制:合理设计多线程或异步IO(如asyncio)以提高采集速度,但同时必须严格控制请求频率,避免对目标服务器造成过大压力。

- 错误处理与日志:建立完善的异常处理机制和日志系统,确保程序在遇到网络波动、页面结构变化等问题时能做出恰当响应,并记录详细信息以供调试。

三、合规与道德考量

在开发和使用淘宝商品采集软件时,必须严格遵守法律法规和平台规则。

- 遵守Robots协议:尊重网站的

robots.txt文件规定。 - 控制访问频率:采集行为应模拟人类正常浏览,避免高频请求导致服务器负载过重,这既是技术需要,也是法律和道德要求。

- 数据使用范围:采集的数据应用于合法的个人学习、市场分析等目的。严禁用于恶意比价、数据盗卖、侵犯商家隐私或商业机密等非法活动。

- 知识产权尊重:商品图片、描述文本等可能受版权保护,未经许可不得用于商业用途。

- 用户协议:明确违反淘宝用户协议可能导致账号被封禁,软件开发者有责任在用户协议中向最终用户提示相关风险。

四、

开发一款稳定、高效、合规的淘宝商品采集软件,是一项融合了网络爬虫技术、前端交互设计和法律风险意识的综合性工作。开发者不仅需要攻克技术难关,如动态页面渲染、反爬策略绕过等,更需时刻将数据的合法合规使用放在首位。对于用户而言,选择合适的软件并遵循合规指引,才能让数据采集工具真正成为提升决策效率、洞察市场动态的得力助手,而非法律风险的源头。

(注:本文仅供技术探讨与学习参考,实际开发与应用务必确保符合相关法律法规及平台政策。)